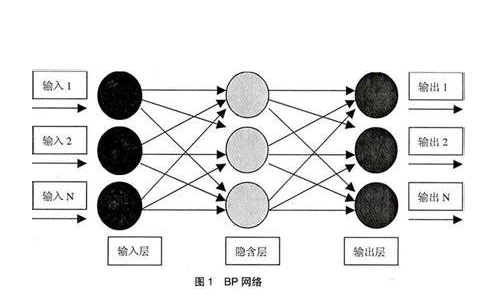

BP神經網絡(Backpropagation Neural Network)是一種多層前饋神經網絡,其核心思想是通過反向傳播算法來調整網絡權重,使得網絡的輸出盡可能接近目標值。在MATLAB中,可以使用內置的神經網絡工具箱來實現BP神經網絡的構建、訓練和分析。

- 網絡結構設計

在進行BP神經網絡分析之前,首先需要設計合適的網絡結構。網絡結構主要包括輸入層、隱藏層和輸出層。輸入層的神經元數量取決于問題的特征維度,輸出層的神經元數量取決于問題的輸出維度。隱藏層的數量和神經元數量則需要根據具體問題進行調整。

1.1 輸入層設計

輸入層的神經元數量應該與問題的特征維度相等。例如,如果問題的特征向量包含10個特征,則輸入層應該有10個神經元。輸入層的激活函數通常選擇線性函數,即f(x) = x。

1.2 隱藏層設計

隱藏層的數量和神經元數量對網絡的性能有很大影響。一般來說,隱藏層的數量可以根據問題的復雜程度進行選擇,通常為1-3層。每層隱藏層的神經元數量可以根據問題的規模和特征維度進行調整。常用的方法有:

- 經驗法:根據問題規模和經驗選擇合適的神經元數量。

- 試錯法:通過多次實驗,逐漸調整神經元數量,找到最優解。

- 信息論法:根據信息熵和互信息等指標來確定神經元數量。

1.3 輸出層設計

輸出層的神經元數量取決于問題的輸出維度。例如,如果問題是二分類問題,則輸出層應該有2個神經元;如果是多分類問題,則輸出層應該有類別數個神經元。輸出層的激活函數通常選擇softmax函數,用于將輸出值轉換為概率分布。

- 訓練過程

在設計好網絡結構后,接下來需要進行訓練。訓練過程主要包括數據預處理、網絡初始化、訓練算法選擇和訓練參數設置等步驟。

2.1 數據預處理

數據預處理是訓練前的重要步驟,包括歸一化、去中心化、特征選擇等操作。歸一化可以將數據縮放到[0,1]或[-1,1]的范圍內,有助于提高訓練速度和收斂性。去中心化是將數據的均值調整為0,有助于提高網絡的泛化能力。特征選擇則是從原始數據中選擇對問題有貢獻的特征,減少噪聲和冗余。

2.2 網絡初始化

網絡初始化是為網絡的權重和偏置賦予初始值的過程。權重和偏置的初始值對網絡的訓練和性能有很大影響。常用的初始化方法有:

- 隨機初始化:為權重和偏置賦予小的隨機值。

- 正態分布初始化:為權重和偏置賦予正態分布的值。

- 均勻分布初始化:為權重和偏置賦予均勻分布的值。

2.3 訓練算法選擇

BP神經網絡的訓練算法主要有梯度下降法、共軛梯度法、Levenberg-Marquardt算法等。梯度下降法是最常用的訓練算法,其核心思想是通過計算損失函數的梯度來更新網絡權重。共軛梯度法和Levenberg-Marquardt算法則是在梯度下降法的基礎上進行改進,以提高訓練速度和收斂性。

2.4 訓練參數設置

訓練參數主要包括學習率、迭代次數、目標誤差等。學習率決定了權重更新的幅度,過小的學習率會導致訓練速度慢,過大的學習率則可能導致訓練不收斂。迭代次數決定了訓練的輪數,過多的迭代次數會增加訓練時間,過少的迭代次數則可能導致訓練不充分。目標誤差則是訓練過程中的停止條件,當損失函數的值小于目標誤差時,訓練停止。

- 結果評估

在訓練完成后,需要對網絡的性能進行評估。常用的評估指標有準確率、召回率、F1分數、ROC曲線等。

3.1 準確率

準確率是最常用的評估指標,表示分類正確的樣本數占總樣本數的比例。計算公式為:

準確率 = 正確分類的樣本數 / 總樣本數

3.2 召回率

召回率表示分類為正類的樣本中,實際為正類的比例。計算公式為:

召回率 = 正確分類為正類的樣本數 / 實際為正類的樣本數

3.3 F1分數

F1分數是準確率和召回率的調和平均值,用于衡量模型的平衡性。計算公式為:

F1分數 = 2 * (準確率 * 召回率) / (準確率 + 召回率)

-

數據

+關注

關注

8文章

7253瀏覽量

91754 -

BP神經網絡

+關注

關注

2文章

127瀏覽量

30970 -

函數

+關注

關注

3文章

4379瀏覽量

64737 -

神經元

+關注

關注

1文章

368瀏覽量

18819

發布評論請先 登錄

matlab bp神經網絡分析結果怎么看

matlab bp神經網絡分析結果怎么看

評論