隨著各大公司爭相加入人工智能的潮流,芯片和人才供不應求。初創公司SambaNova(https://sambanova.ai/)聲稱,其新處理器可以幫助公司在幾天內建立并運行自己的大型語言模型(LLM,https://spectrum.ieee.org/large-language-models-math)。

這家總部位于帕洛阿爾托的公司已經籌集了超過10億美元的風險投資,不會直接向公司出售芯片。相反,它出售其定制技術堆棧的訪問權限,該堆棧具有專門為運行最大的人工智能模型而設計的專有硬件和軟件。

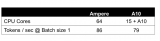

在該公司推出新的SN40L處理器后,該技術堆棧現在得到了重大升級。每個器件采用臺灣芯片巨頭臺灣半導體制造有限公司的5納米工藝制造,具有1020億個晶體管,分布在1040個核上,速度高達638萬億次。它還有一個新穎的三層內存系統,旨在應對與人工智能工作負載相關的巨大數據流。

SambaNova聲稱,一個僅由八個芯片組成的節點能夠支持多達5萬億個參數的模型,這幾乎是OpenAI GPT-4 LLM報告(https://the-decoder.com/gpt-4-architecture-datasets-costs-and-more-leaked/)大小的三倍。序列長度(衡量模型可以處理的輸入長度)高達256000個令牌。首席執行官Rodrigo Liang表示,使用行業標準GPU也需要數百個芯片,這意味著總擁有成本不到行業標準方法的1/25。

Liang說:“如果你能在八個芯片插座上運行一萬億個參數,那么它實際上并不是一個大模型。我們正在瓦解成本結構,并真正重構人們對此的看法,而不是將萬億參數模型視為無法訪問的東西。”

新芯片使用了與該公司以前的處理器相同的數據流架構。SambaNova的基本論點是,現有的芯片設計過于關注簡化指令流,但對于大多數機器學習應用程序來說,數據的高效移動是一個更大的瓶頸。

為了解決這一問題,該公司的芯片采用了一個由高速交換結構連接的存儲器和計算單元組成的平鋪陣列,這使得根據手頭的問題動態重新配置單元的連接方式成為可能。這與該公司的SambaFlow軟件協同工作,該軟件可以分析機器學習模型,并找出連接單元的最佳方式,以確保無縫數據流和最大限度地使用硬件。

除了從7納米工藝轉變為5納米工藝外,該公司最新芯片與其前身SN30的主要區別在于增加了第三層存儲層。早期的芯片具有640兆字節的片上SRAM和1兆字節的外部DRAM,但SN40L將具有520兆字節的芯片上存儲器、1.5兆字節的內部存儲器和額外的64兆字節的高帶寬存儲器(HBM)。

內存越來越成為人工智能芯片的一個關鍵區別,因為生成的人工智能模型不斷膨脹,這意味著移動數據對性能的拖累往往大于原始計算能力。這促使公司提高芯片上的內存量和速度。SambaNova并不是第一個求助于HBM來對抗這種所謂的內存墻的公司,其新芯片的內存比競爭對手少——英偉達業界領先的H100 GPU的內存為80GB,而AMD即將推出的MI300X GPU的內存將為192GB。SambaNova不愿透露其內存的帶寬數據,因此很難判斷它與其他芯片的對比情況。

Liang說,雖然SambaNova更依賴于較慢的外部內存,但它的技術是一種軟件編譯器,可以智能地在三個內存層之間分配負載。該公司芯片之間的專有互連還允許編譯器將八個處理器的設置視為單個系統。Liang表示:“訓練中的表現將會非常棒。”

SambaNova對如何處理人工智能芯片的另一個熱門話題——稀疏性也持謹慎態度。LLM中的許多權重都設置為零,因此對它們執行操作是浪費計算。找到利用這種稀疏性的方法可以提供顯著的加速。SambaNova在其宣傳材料中聲稱,SN40L“提供密集和稀疏計算”。Liang說,這在一定程度上是通過調度和如何將數據帶到芯片上在軟件層實現的,但他也拒絕討論硬件組件。“稀疏問題是一個戰場,”他說,“所以我們還沒有準備好透露我們是如何做到的。”

幫助人工智能芯片更快、更便宜地運行大型模型的另一個常見技巧是降低參數的表示精度。SN40L使用谷歌工程師發明的bfloat16數字格式,也支持8位精度,但Liang表示,低精度計算不是他們的重點,因為他們的架構已經允許他們在更小的占地面積上運行模型。

Liang表示,該公司的技術堆棧明確專注于運行最大的人工智能模型——他們的目標受眾是世界上2000家最大的公司。銷售宣傳是,這些公司坐擁大量數據,但他們不知道其中大部分都在說什么。SambaNova表示,它可以提供構建人工智能模型所需的所有硬件和軟件,解鎖這些數據,而無需公司為芯片或人工智能人才而戰。Liang說:“你可以在幾天內啟動并運行,而不是幾個月或幾個季度。現在每家公司都可以擁有自己的GPT模型。”

Gartner分析師Chirag Dekate表示,SN40L可能比競爭對手硬件具有顯著優勢的一個領域是多模式人工智能。他表示,生成型人工智能的未來是可以處理各種不同類型數據的大型模型,如圖像、視頻和文本,但這會導致高度可變的工作負載。Dekate說,GPU中相當嚴格的體系結構不太適合這種工作,但這正是SambaNova對可重構性的關注所在。“你可以調整硬件以滿足工作負載的要求,”他說。

然而,Dekate說,像SambaNova制造的定制人工智能芯片確實在性能和靈活性之間進行了權衡。盡管GPU可能沒有那么強大,但它們幾乎可以開箱即用地運行任何神經網絡,并得到強大的軟件生態系統的支持。Dekate指出,SambaNova一直在建立一個客戶可以利用的預烘焙模型目錄,但英偉達在人工智能開發各個方面的主導地位是一個重大挑戰。

Dekate說:“這種架構實際上優于傳統的GPU架構。但除非你把這些技術掌握在客戶手中,實現大規模消費化,否則我認為你很可能會陷入困境。”

咨詢公司SemiAnalysis的首席分析師Dylan Patel表示,由于英偉達也在通過其DGX云產品進軍全棧人工智能即服務市場,這將更加具有挑戰性。“芯片是向前邁出的重要一步,”他說。

審核編輯:彭菁

-

晶體管

+關注

關注

77文章

10005瀏覽量

141201 -

人工智能

+關注

關注

1805文章

48913瀏覽量

248042 -

語言模型

+關注

關注

0文章

561瀏覽量

10738 -

SambaNova

+關注

關注

0文章

7瀏覽量

292

原文標題:SambaNova的新芯片可運行比OpenAI的ChatGPT高級版大兩倍以上的模型

文章出處:【微信號:IEEE_China,微信公眾號:IEEE電氣電子工程師】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

無法在OVMS上運行來自Meta的大型語言模型 (LLM),為什么?

小白學大模型:訓練大語言模型的深度指南

大語言模型的解碼策略與關鍵優化總結

大語言模型開發語言是什么

如何訓練自己的LLM模型

如何訓練自己的AI大模型

如何利用大型語言模型驅動的搜索為公司創造價值

【《大語言模型應用指南》閱讀體驗】+ 基礎知識學習

【《大語言模型應用指南》閱讀體驗】+ 俯瞰全書

DeepL推出新一代翻譯編輯大型語言模型

基于CPU的大型語言模型推理實驗

SambaNova即將建立并運行自己的大型語言模型

SambaNova即將建立并運行自己的大型語言模型

評論