3D 生成是 AI 視覺領(lǐng)域的研究熱點(diǎn)之一。本文中,來自 Adobe 研究院和斯坦福大學(xué)等機(jī)構(gòu)的研究者利用基于 transformer 的 3D 大型重建模型來對多視圖擴(kuò)散進(jìn)行去噪,并提出了一種新穎的 3D 生成方法 DMV3D,實(shí)現(xiàn)了新的 SOTA 結(jié)果。

2D 擴(kuò)散模型極大地簡化了圖像內(nèi)容的創(chuàng)作流程,2D 設(shè)計行業(yè)也因此發(fā)生了變革。近來,擴(kuò)散模型已擴(kuò)展到 3D 創(chuàng)作領(lǐng)域,減少了應(yīng)用程序(如 VR、AR、機(jī)器人技術(shù)和游戲等)中的人工成本。有許多研究已經(jīng)對使用預(yù)訓(xùn)練的 2D 擴(kuò)散模型,生成具有評分蒸餾采樣(SDS)損失的 NeRFs 方法進(jìn)行了探索。然而,基于 SDS 的方法通常需要花費(fèi)數(shù)小時來優(yōu)化資源,并且經(jīng)常引發(fā)圖形中的幾何問題,比如多面 Janus 問題。 另一方面,研究者對無需花費(fèi)大量時間優(yōu)化每個資源,也能夠?qū)崿F(xiàn)多樣化生成的 3D 擴(kuò)散模型也進(jìn)行了多種嘗試。這些方法通常需要獲取包含真實(shí)數(shù)據(jù)的 3D 模型 / 點(diǎn)云用于訓(xùn)練。然而,對于真實(shí)圖像來說,這種訓(xùn)練數(shù)據(jù)難以獲得。由于目前的 3D 擴(kuò)散方法通常基于兩階段訓(xùn)練,這導(dǎo)致在不分類、高度多樣化的 3D 數(shù)據(jù)集上存在一個模糊且難以去噪的潛在空間,使得高質(zhì)量渲染成為亟待解決的挑戰(zhàn)。

為了解決這個問題,已經(jīng)有研究者提出了單階段模型,但這些模型大多數(shù)只針對特定的簡單類別,泛化性較差。

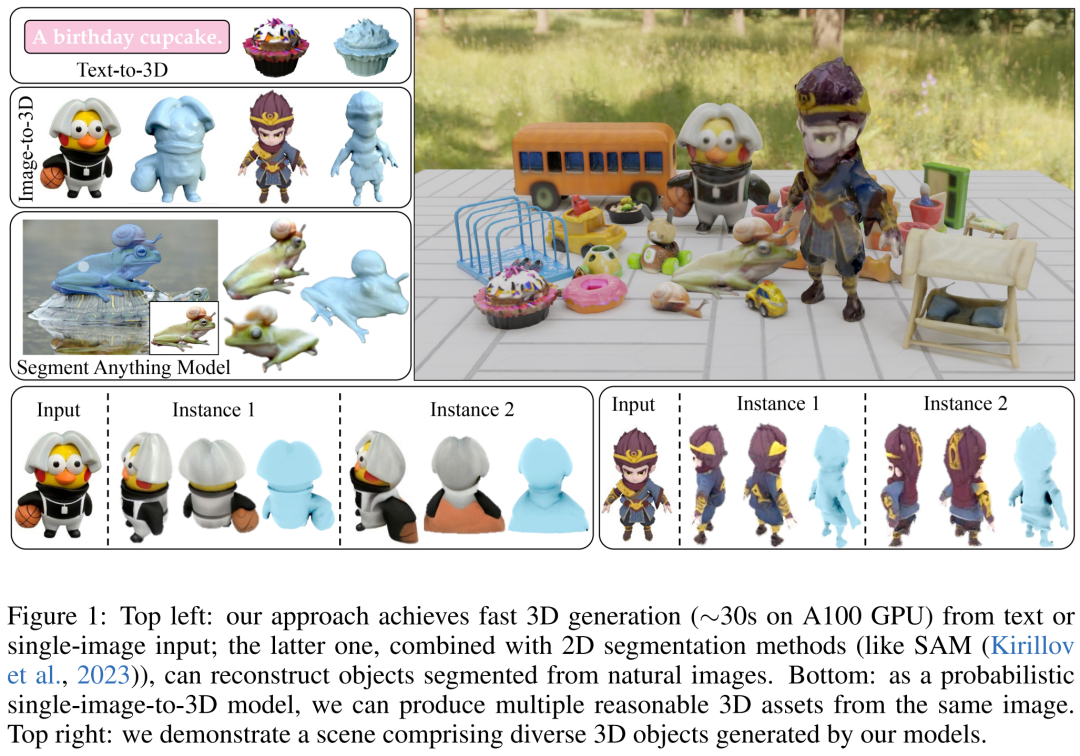

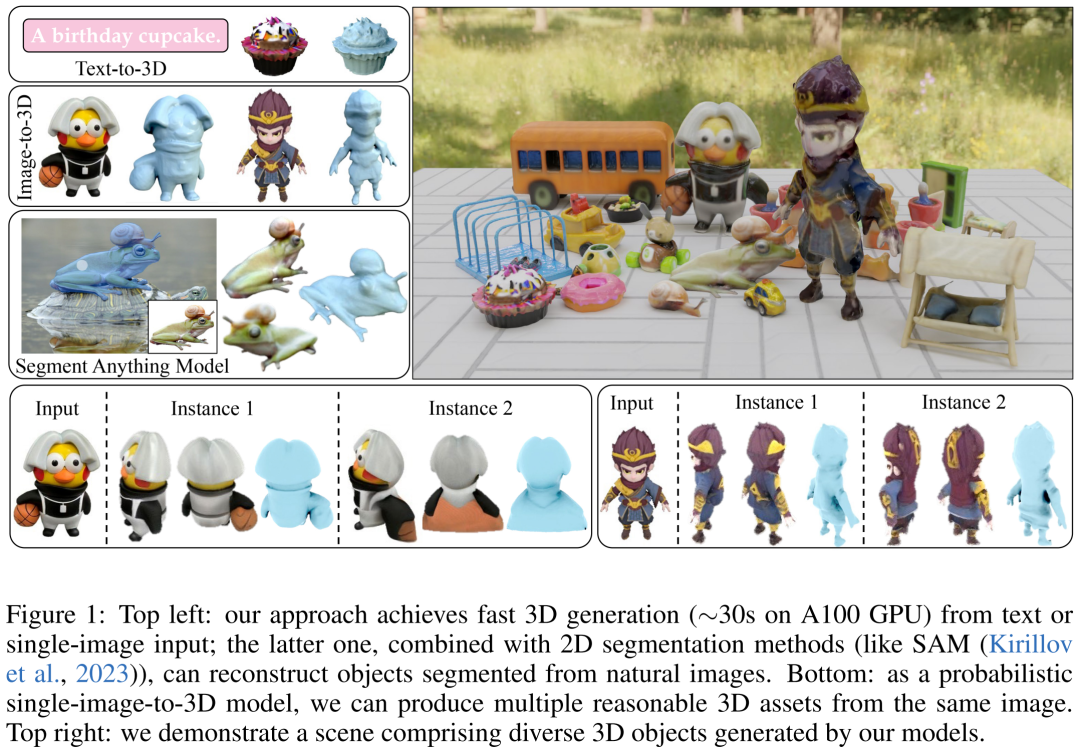

因此,本文研究者的目標(biāo)是實(shí)現(xiàn)快速、逼真和通用的 3D 生成。為此,他們提出了 DMV3D。DMV3D 是一種全新的單階段的全類別擴(kuò)散模型,能直接根據(jù)模型文字或單張圖片的輸入,生成 3D NeRF。在單個 A100 GPU 上,僅需 30 秒,DMV3D 就能生成各種高保真 3D 圖像。

具體來講,DMV3D 是一個 2D 多視圖圖像擴(kuò)散模型,它將 3D NeRF 重建和渲染集成到其降噪器中,以端到端的方式進(jìn)行訓(xùn)練,而無需直接 3D 監(jiān)督。這避免了單獨(dú)訓(xùn)練用于潛在空間擴(kuò)散的 3D NeRF 編碼器(如兩階段模型)和繁瑣的對每個對象進(jìn)行優(yōu)化的方法(如 SDS)中會出現(xiàn)的問題。

本質(zhì)上,本文的方法是對 2D 多視圖擴(kuò)散的框架進(jìn)行 3D 重建。這種方法受到了 RenderDiffusion 的啟發(fā),它是一種通過單視圖擴(kuò)散實(shí)現(xiàn) 3D 生成的方法。然而,RenderDiffusion 的局限性在于,訓(xùn)練數(shù)據(jù)需要特定類別的先驗(yàn)知識,數(shù)據(jù)中的對象也需要特定的角度或姿勢,因此泛化性很差,無法對任意類型的對象進(jìn)行 3D 生成。

相比之下,研究者認(rèn)為一組稀疏的包含一個對象的四個多視角的投影,足以描述一個沒有被遮擋的 3D 物體。這種訓(xùn)練數(shù)據(jù)的輸入源于人類的空間想象能力。他們可以根據(jù)幾個對象的周圍的平面視圖,想象出一個完整的 3D 物體。這種想象通常是非常確定和具像化的。

然而,利用這種輸入本質(zhì)上仍需解決稀疏視圖下 3D 重建的任務(wù)。這是一個長期存在的問題,即使在輸入沒有噪聲的情況下,也是一個非常具有挑戰(zhàn)性的問題。

本文的方法能夠基于單個圖像 / 文本實(shí)現(xiàn) 3D 生成。對于圖像輸入,他們固定一個稀疏視圖作為無噪聲輸入,并對其他視圖進(jìn)行類似于 2D 圖像修復(fù)的降噪。為了實(shí)現(xiàn)基于文本的 3D 生成,研究者使用了在 2D 擴(kuò)散模型中通常會用到的、基于注意力的文本條件和不受類型限制的分類器。

他們只采用了圖像空間監(jiān)督,在 Objaverse 合成的圖像和 MVImgNet 真實(shí)捕獲的圖像組成的大型數(shù)據(jù)集上進(jìn)行了訓(xùn)練。從結(jié)果來看,DMV3D 在單圖像 3D 重建方面取得了 SOTA,超越了先前基于 SDS 的方法和 3D 擴(kuò)散模型。DMV3D 生成的基于文本的 3D 模型,也優(yōu)于此前的方法。

論文地址:https://arxiv.org/pdf/2311.09217.pdf

官網(wǎng)地址:https://justimyhxu.github.io/projects/dmv3d/

我們來看一下生成的 3D 圖像效果。

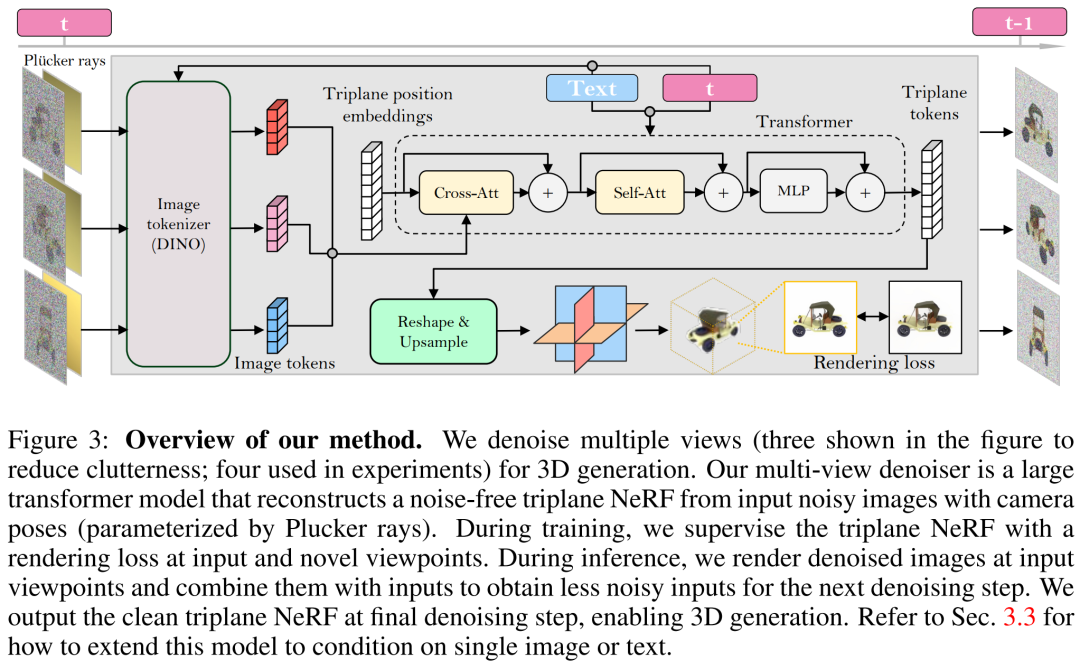

方法概覽 單階段 3D 擴(kuò)散模型是如何訓(xùn)練并推理的呢? 研究者首先引入了一種新的擴(kuò)散框架,該框架使用基于重建的降噪器來對有噪聲的多視圖圖像去噪以進(jìn)行 3D 生成;其次他們提出了一種新的、以擴(kuò)散時間步為條件的、基于 LRM 的多視圖降噪器,從而通過 3D NeRF 重建和渲染來漸進(jìn)地對多視圖圖像進(jìn)行去噪;最后進(jìn)一步對模型進(jìn)行擴(kuò)散,支持文本和圖像調(diào)節(jié),實(shí)現(xiàn)可控生成。

多視圖擴(kuò)散和去噪

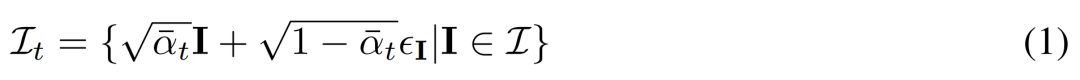

多視圖擴(kuò)散。2D擴(kuò)散模型中處理的原始 x_0 分布在數(shù)據(jù)集中是單個圖像分布。相反,研究者考慮的是多視圖圖像

的聯(lián)合分布,其中每組

都是從視點(diǎn) C = {c_1, .. ., c_N} 中相同 3D 場景(資產(chǎn))的圖像觀察結(jié)果。擴(kuò)散過程相當(dāng)于使用相同的噪聲調(diào)度獨(dú)立地對每個圖像進(jìn)行擴(kuò)散操作,如下公式(1) 所示。

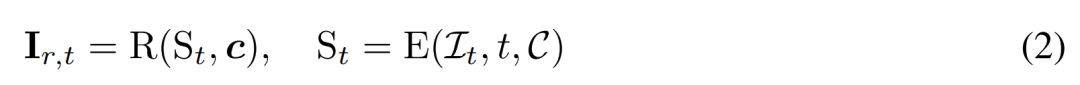

基于重建的去噪。2D 擴(kuò)散過程的逆過程本質(zhì)上是去噪。本文中,研究者提出利用 3D 重建和渲染來實(shí)現(xiàn) 2D 多視圖圖像去噪,同時輸出干凈的、用于 3D 生成的 3D 模型。具體來講,他們使用 3D 重建模塊 E (?) 來從有噪聲的多視圖圖像

中重建 3D 表示 S,并使用可微渲染模塊 R (?) 對去噪圖像進(jìn)行渲染,如下公式 (2) 所示。

基于重建的多視圖降噪器

研究者基于 LRM 構(gòu)建了多視圖降噪器,并使用大型 transformer 模型從有噪聲的稀疏視圖姿態(tài)圖像中重建了一個干凈的三平面 NeRF,然后將重建后的三平面 NeRF 的渲染用作去噪輸出。

重建和渲染。如下圖 3 所示,研究者使用一個 Vision Transformer(DINO)來將輸入圖像

轉(zhuǎn)化為 2D token,然后使用 transformer 將學(xué)得的三平面位置嵌入映射到最后的三平面,以表示資產(chǎn)的 3D 形狀和外觀。接下來將預(yù)測到的三平面用來通過一個 MLP 來解碼體積密度和顏色,以進(jìn)行可微體積渲染。

時間調(diào)節(jié)。與基于 CNN 的 DDPM(去噪擴(kuò)散概率模型)相比,本文基于 transformer 的模型需要不同的時間調(diào)節(jié)設(shè)計。

相機(jī)調(diào)節(jié)。在具有高度多樣化的相機(jī)內(nèi)參和外參的數(shù)據(jù)集(如 MVImgNet)上訓(xùn)練本文的模型時,研究者表示需要對輸入相機(jī)調(diào)節(jié)進(jìn)行有效的設(shè)計,以促使模型理解相機(jī)并實(shí)現(xiàn) 3D 推理。

在單個圖像或文本上調(diào)節(jié)

以上方法使研究者提出的模型可以充當(dāng)一個無條件生成模型。他們介紹了如何利用條件降噪器

來對條件概率分布進(jìn)行建模,其中 y 表示文本或圖像,以實(shí)現(xiàn)可控 3D 生成。

圖像調(diào)節(jié)。研究者提出了一種簡單但有效的圖像調(diào)節(jié)策略,其中不需要改變模型的架構(gòu)。

文本調(diào)節(jié)。為了將文本調(diào)節(jié)添加到自己的模型中,研究者采用了類似于 Stable Diffusion 的策略。他們使用 CLIP 文本編碼器生成文本嵌入,并使用交叉注意力將它們注入到降噪器中。

訓(xùn)練和推理

訓(xùn)練。在訓(xùn)練階段,研究者在范圍 [1, T] 內(nèi)均勻地采樣時間步 t,并根據(jù)余弦調(diào)度來添加噪聲。他們使用隨機(jī)相機(jī)姿態(tài)對輸入圖像進(jìn)行采樣,還隨機(jī)采樣額外的新視點(diǎn)來監(jiān)督渲染以獲得更好的質(zhì)量。

研究者使用條件信號 y 來最小化以下訓(xùn)練目標(biāo)。

推理。在推理階段,研究者選擇了以圓圈均勻圍繞對象的視點(diǎn),以確保很好地覆蓋生成的 3D 資產(chǎn)。他們將四個視圖的相機(jī)市場角固定為 50 度。

實(shí)驗(yàn)結(jié)果

在實(shí)驗(yàn)環(huán)節(jié),研究者使用了 AdamW 優(yōu)化器來訓(xùn)練自己的模型,其中初始學(xué)習(xí)率為 4e^-4。他們針對該學(xué)習(xí)率使用了 3K 步的預(yù)熱和余弦衰減,使用 256 × 256 輸入圖像來訓(xùn)練降噪器,對 128 × 128 的裁剪圖像進(jìn)行渲染以進(jìn)行監(jiān)督。

關(guān)于數(shù)據(jù)集,研究者的模型只需多視圖姿態(tài)圖像來訓(xùn)練,因而使用來自 Objaverse 數(shù)據(jù)集的約 730k 個對象的渲染后多視圖圖像。對于每個對象,他們按照 LRM 的設(shè)置,在對固定 50 度 FOV 的隨機(jī)視點(diǎn)均勻照明下,渲染了 32 張圖像。

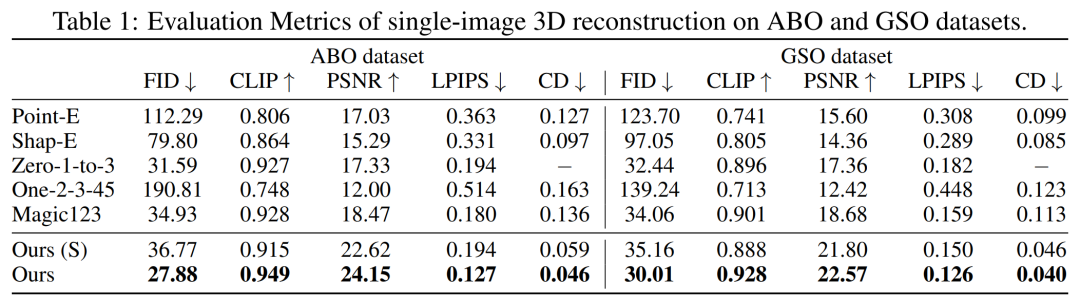

首先是單圖像重建。研究者將自己的圖像 - 調(diào)節(jié)模型與 Point-E、Shap-E、Zero-1-to-3 和 Magic123 等以往方法在單圖像重建任務(wù)上進(jìn)行了比較。他們使用到的指標(biāo)有 PSNR、LPIPS、CLIP 相似性得分和 FID,以評估所有方法的新視圖渲染質(zhì)量。

下表 1 分別展示了 GSO 和 ABO 測試集上的定量結(jié)果。研究者的模型優(yōu)于所有基線方法,并在兩個數(shù)據(jù)集上實(shí)現(xiàn)所有指標(biāo)的新 SOTA。

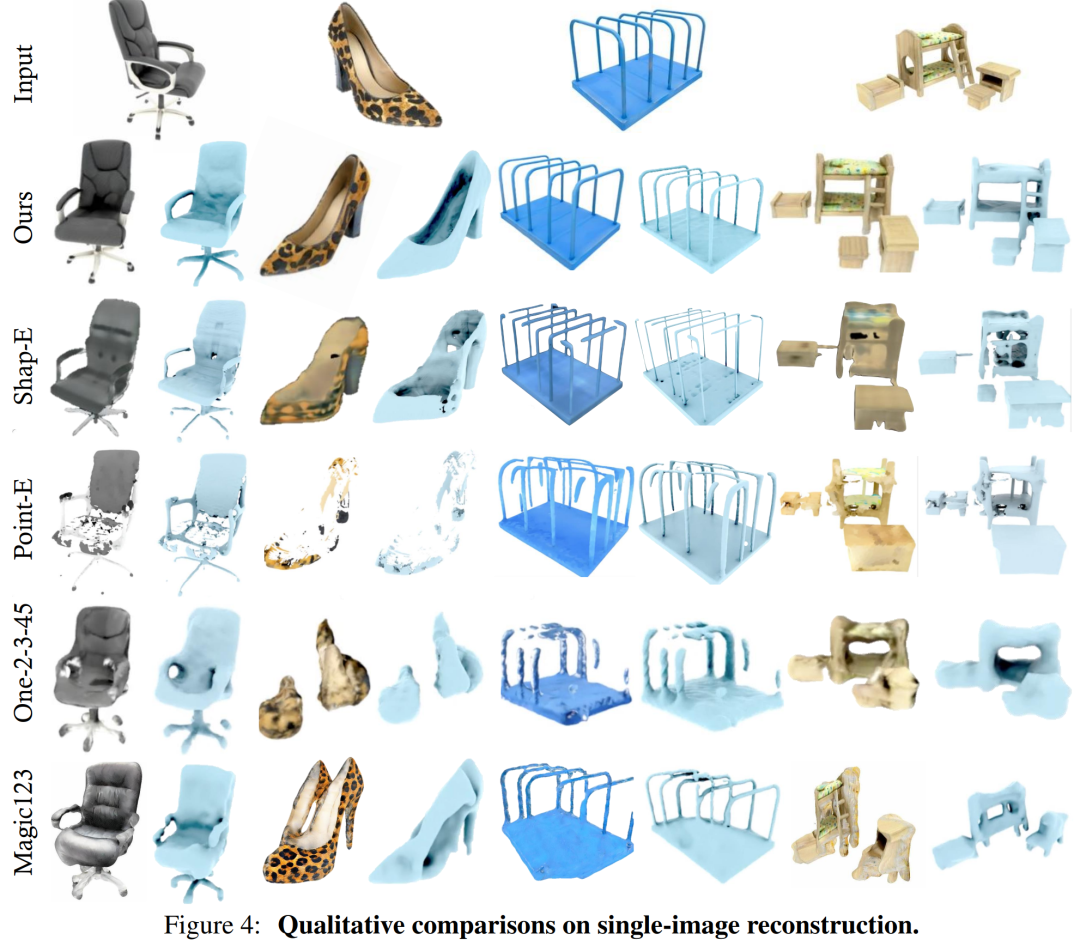

圖 4 為定性結(jié)果,相比基線,本文模型生成的結(jié)果具有更高質(zhì)量的幾何和更清晰的外觀細(xì)節(jié)。

相比之下,DMV3D 是一個以 2D 圖像為訓(xùn)練目標(biāo)的單階段模型,無需對每個資產(chǎn)單獨(dú)優(yōu)化,在消除多視圖擴(kuò)散噪聲的同時,直接生成 3D NeRF 的模型。總的來說,DMV3D 可以快速生成 3D 圖像,并獲得最優(yōu)的單圖像 3D 重建結(jié)果。

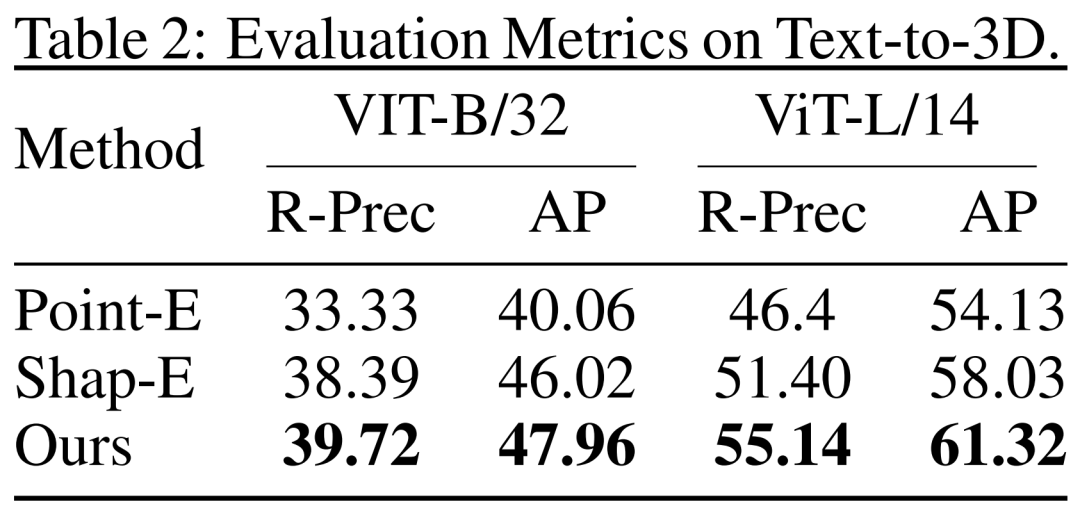

從文本到 3D。研究者還評估了 DMV3D 基于文本的 3D 生成結(jié)果。研究者將 DMV3D 和同樣能夠支持全類別的快速推理的 Shap-E 和 Point-E 進(jìn)行了比較。研究者讓三個模型根據(jù) Shap-E 的 50 個文本提示進(jìn)行生成,并使用了兩個不同的 ViT 模型的 CLIP 精度和平均精度來評估生成結(jié)果,如表 2 所示。

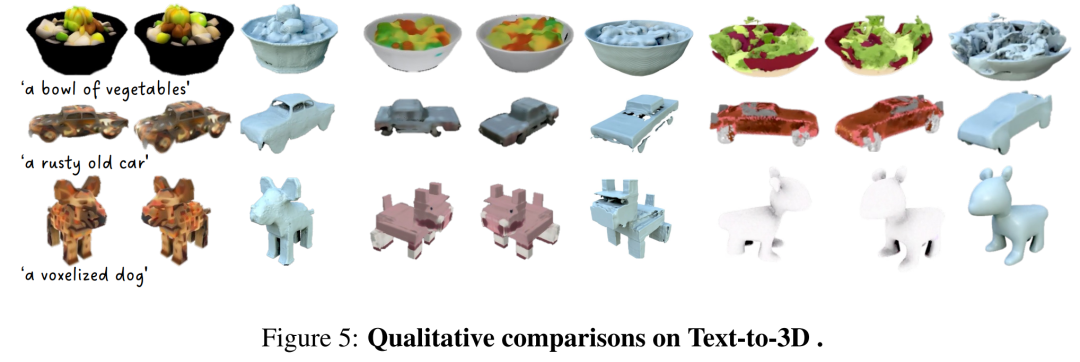

從表中可以看出,DMV3D 表現(xiàn)出了最佳的精度。圖 5 中是定性結(jié)果,相比于其他模型的生成結(jié)果,DMV3D 生成的圖形明顯包含更豐富的幾何和外觀細(xì)節(jié),結(jié)果也更逼真。

其他結(jié)果

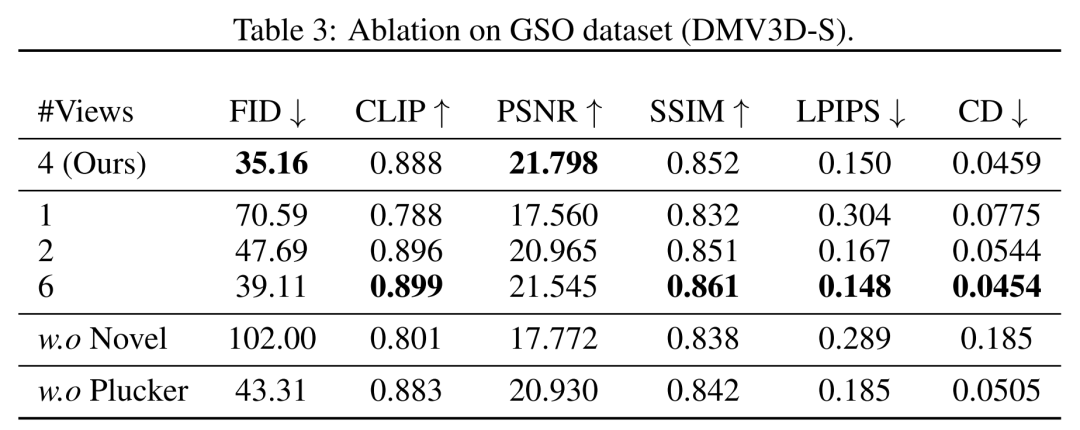

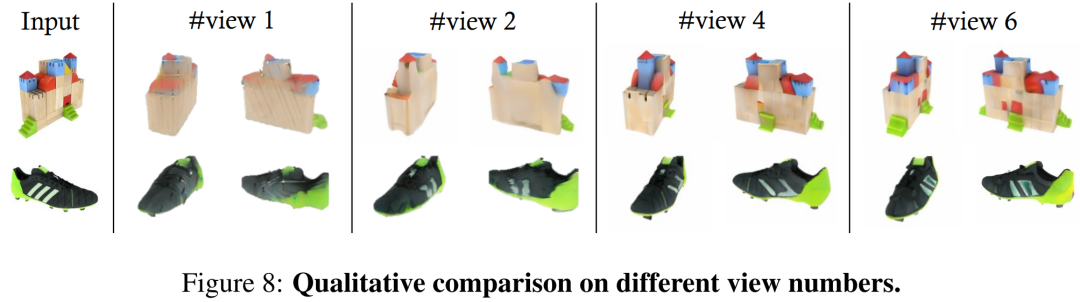

在視角方面,研究者在表 3 和圖 8 中顯示了用不同數(shù)量(1、2、4、6)的輸入視圖訓(xùn)練的模型的定量和定性比較。

在多實(shí)例生成方面,與其他擴(kuò)散模型類似,本文提出的模型可以根據(jù)隨機(jī)輸入生成多種示例,如圖 1 所示,展示了該模型生成結(jié)果的泛化性。

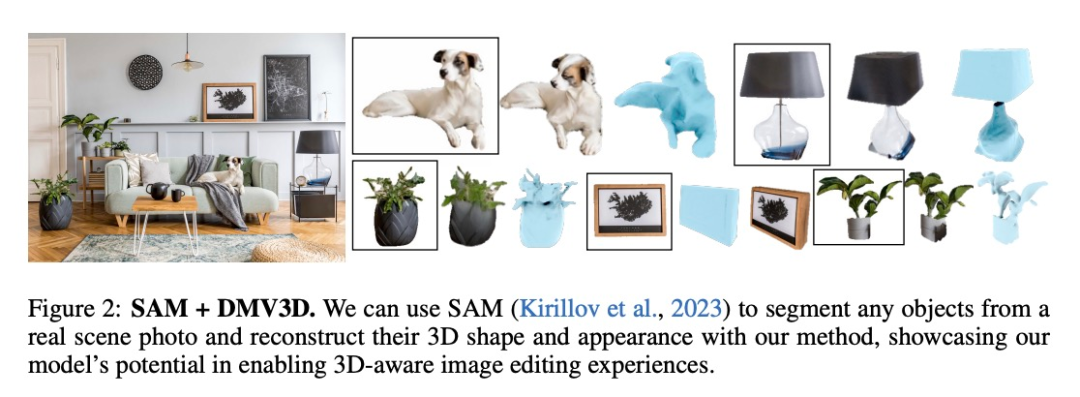

在應(yīng)用方面,DMV3D 具備廣泛的靈活性和通用性,在 3D 生成應(yīng)用領(lǐng)域具備較強(qiáng)的發(fā)展?jié)摿ΑH鐖D 1 和圖 2 所示,本文方法能夠在圖像編輯應(yīng)用程序中通過分割(如 SAM)等方法將 2D 照片中的任意對象提升到 3D 的維度。

更多技術(shù)細(xì)節(jié)和實(shí)驗(yàn)結(jié)果請查閱原論文。

-

編碼器

+關(guān)注

關(guān)注

45文章

3790瀏覽量

137804 -

3D

+關(guān)注

關(guān)注

9文章

2958瀏覽量

110603 -

Transformer

+關(guān)注

關(guān)注

0文章

151瀏覽量

6491

原文標(biāo)題:ICLR 2024 | Adobe提出DMV3D:3D生成只需30秒!讓文本、圖像都動起來的新方法!

文章出處:【微信號:CVer,微信公眾號:CVer】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

NVIDIA助力影眸科技3D生成工具Rodin升級

一種以圖像為中心的3D感知模型BIP3D

3D打印技術(shù):如何讓古老文物重獲新生?

SciChart 3D for WPF圖表庫

騰訊混元3D AI創(chuàng)作引擎正式發(fā)布

騰訊混元3D AI創(chuàng)作引擎正式上線

AN-1249:使用ADV8003評估板將3D圖像轉(zhuǎn)換成2D圖像

e絡(luò)盟互動社區(qū)發(fā)起“動起來”設(shè)計大賽

安寶特產(chǎn)品 安寶特3D Analyzer:智能的3D CAD高級分析工具

使用NVIDIA Edify助力的服務(wù)創(chuàng)建3D資產(chǎn)和虛擬環(huán)境照明

歡創(chuàng)播報 騰訊元寶首發(fā)3D生成應(yīng)用

Adobe提出DMV3D:3D生成只需30秒!讓文本、圖像都動起來的新方法!

Adobe提出DMV3D:3D生成只需30秒!讓文本、圖像都動起來的新方法!

評論