本來想把題目取為“從煉丹到化學(xué)”,但是這樣的題目太言過其實(shí),遠(yuǎn)不是近期可以做到的,學(xué)術(shù)研究需要嚴(yán)謹(jǐn)。但是,尋找適當(dāng)?shù)臄?shù)學(xué)工具去建模深度神經(jīng)網(wǎng)絡(luò)表達(dá)能力和訓(xùn)練能力,將基于經(jīng)驗(yàn)主義的調(diào)參式深度學(xué)習(xí),逐漸過渡為基于一些評測指標(biāo)定量指導(dǎo)的深度學(xué)習(xí), 是新一代人工智能需要面對的課題,也是在當(dāng)前深度學(xué)習(xí)渾渾噩噩的大背景中的一些新的希望。

這篇短文旨在介紹團(tuán)隊(duì)近期的ICML工作——”Towards a Deep and Unified Understanding of Deep Neural Models in NLP”(這篇先介紹NLP領(lǐng)域,以后有時間再介紹類似思想解釋CV網(wǎng)絡(luò)的論文)。這是我與微軟亞洲研究院合作的一篇論文。其中,微軟研究院的王希廷研究員在NLP方向有豐富經(jīng)驗(yàn),王老師和關(guān)超宇同學(xué)在這個課題上做出了非常巨大的貢獻(xiàn),這里再三感謝。

大家說神經(jīng)網(wǎng)絡(luò)是“黑箱”,其含義至少有以下兩個方面:一、神經(jīng)網(wǎng)絡(luò)特征或決策邏輯在語義層面難以理解;二、缺少數(shù)學(xué)工具去診斷與評測網(wǎng)絡(luò)的特征表達(dá)能力(比如,去解釋深度模型所建模的知識量、其泛化能力和收斂速度),進(jìn)而解釋目前不同神經(jīng)網(wǎng)絡(luò)模型的信息處理特點(diǎn)。

過去我的研究一直關(guān)注第一個方面,而這篇ICML論文同時關(guān)注以上兩個方面——針對不同自然語言應(yīng)用的神經(jīng)網(wǎng)絡(luò),尋找恰當(dāng)?shù)臄?shù)學(xué)工具去建模其中層特征所建模的信息量,并可視化其中層特征的信息分布,進(jìn)而解釋不同模型的性能差異。

其實(shí),我一直希望去建模神經(jīng)網(wǎng)絡(luò)的特征表達(dá)能力,但是又一直遲遲不愿意下手去做。究其原因,無非是找不到一套優(yōu)美的數(shù)學(xué)建模方法。深度學(xué)習(xí)研究及其應(yīng)用很多已經(jīng)被人詬病為“經(jīng)驗(yàn)主義”與“拍腦袋”,我不能讓其解釋性算法也淪為經(jīng)驗(yàn)主義式的拍腦袋——不然解釋性工作還有什么意義。

研究的難點(diǎn)在于對神經(jīng)網(wǎng)絡(luò)表達(dá)能力的評測指標(biāo)需要具備“普適性”和“一貫性”。首先,這里“普適性”是指解釋性指標(biāo)需要定義在某種通用的數(shù)學(xué)概念之上,保證與既有數(shù)學(xué)體系有盡可能多的連接,而與此同時,解釋性指標(biāo)需要建立在盡可能少的條件假設(shè)之上,指標(biāo)的計(jì)算算法盡可能獨(dú)立于神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)和目標(biāo)任務(wù)的選擇。

其次,這里的“一貫性”指評測指標(biāo)需要客觀的反應(yīng)特征表達(dá)能力,并實(shí)現(xiàn)廣泛的比較,比如

診斷與比較同一神經(jīng)網(wǎng)絡(luò)中不同層之間語義信息的繼承與遺忘;

診斷與比較針對同一任務(wù)的不同神經(jīng)網(wǎng)絡(luò)的任意層之間的語義信息分

比較針對不同任務(wù)的不同神經(jīng)網(wǎng)絡(luò)的信息處理特點(diǎn)。

具體來說,在某個NLP應(yīng)用中,當(dāng)輸入某句話x=[x1,x2,…,xn]到目標(biāo)神經(jīng)網(wǎng)絡(luò)時,我們可以把神經(jīng)網(wǎng)絡(luò)的信息處理過程,看成對輸入單詞信息的逐層遺忘的過程。即,網(wǎng)絡(luò)特征每經(jīng)過一層傳遞,就會損失一些信息,而神經(jīng)網(wǎng)絡(luò)的作用就是盡可能多的遺忘與目標(biāo)任務(wù)無關(guān)的信息,而保留與目標(biāo)任務(wù)相關(guān)的信息。于是,相對于目標(biāo)任務(wù)的信噪比會逐層上升,保證了目標(biāo)任務(wù)的分類性能。

我們提出一套算法,測量每一中層特征f中所包含的輸入句子的信息量,即H(X|F=f)。當(dāng)假設(shè)各單詞信息相互獨(dú)立時,我們可以把句子層面的信息量分解為各個單詞的信息量H(X|F=f) = H(X1=x1|F=f) + H(X2=x2|F=f) + … + H(Xn=xn|F=f). 這評測指標(biāo)在形式上是不是與信息瓶頸理論相關(guān)?但其實(shí)兩者還是有明顯的區(qū)別的。信息瓶頸理論關(guān)注全部樣本上的輸入特征與中層特征的互信息,而我們僅針對某一特定輸入,細(xì)粒度地研究每個單詞的信息遺忘程度。

其實(shí),我們可以從兩個不同的角度,計(jì)算出兩組不同的熵H(X|F=f)。(1)如果我們只關(guān)注真實(shí)自然語言的低維流形,那么p(X=x|F=f)的計(jì)算比較容易,可以將p建模為一個decoder,即用中層特征f去重建輸入句子x。(2)在這篇文章中,我們其實(shí)選取了第二個角度:我們不關(guān)注真實(shí)語言的分布,而考慮整個特征空間的分布,即x可以取值為噪聲。在計(jì)算p(X=x,F=f) = p(X=x) p(F=f|X=x)時,我們需要考慮“哪些噪聲輸入也可以生成同樣的特征f”。舉個toy example,當(dāng)輸入句子是"How are you?"時,明顯“are”是廢話,可以從“How XXX you?”中猜得。這時,如果僅從真實(shí)句子分布出發(fā),考慮句子重建,那些話佐料(“are” “is” “an”)將被很好的重建。而真實(shí)研究選取了第二個角度,即我們關(guān)注的是哪些單詞被神經(jīng)網(wǎng)絡(luò)遺忘了,發(fā)現(xiàn)原來“How XYZ you?”也可以生成與“How are you?”一樣的特征。

這時,H(X|F=f)所體現(xiàn)的是,在中層特征f的計(jì)算過程中,哪些單詞的信息在層間傳遞的過程中逐漸被神經(jīng)網(wǎng)絡(luò)所忽略——將這些單詞的信息替換為噪聲,也不會影響其中層特征。這種情況下,信息量H(X|F=f)不是直接就可以求出來的,如何計(jì)算信息量也是這個課題的難點(diǎn)。具體求解的公式推導(dǎo)可以看論文,知乎上只放文字,不談公式。

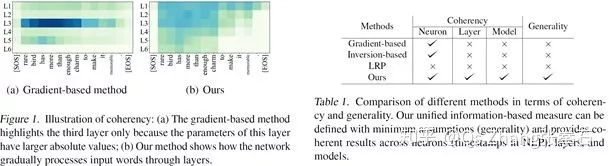

首先,從“普適性”的角度來看,中層特征中輸入句子的信息量(輸入句子的信息的遺忘程度)是信息論中基本定義,它只關(guān)注中層特征背后的“知識量”,而不受網(wǎng)絡(luò)模型參數(shù)大小、中層特征值的大小、中層卷積核順序影響。其次,從“一貫性”的角度來看,“信息量”可以客觀反映層間信息快遞能力,實(shí)現(xiàn)穩(wěn)定的跨層比較。如下圖所示,基于梯度的評測標(biāo)準(zhǔn),無法為不同中間層給出一貫的穩(wěn)定的評測。

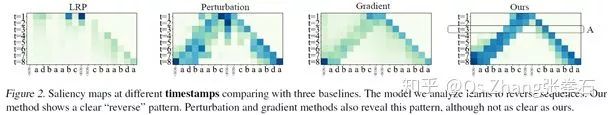

下圖比較了不同可視化方法在分析“reverse sequence”神經(jīng)網(wǎng)絡(luò)中層特征關(guān)注點(diǎn)的區(qū)別。我們基于輸入單詞信息量的方法,可以更加平滑自然的顯示神經(jīng)網(wǎng)絡(luò)內(nèi)部信息處理邏輯。

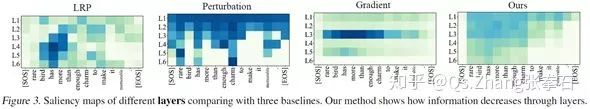

下圖分析比較了不同可視化方法在診斷“情感語義分類”應(yīng)用的神經(jīng)網(wǎng)絡(luò)中層特征關(guān)注點(diǎn)的區(qū)別。我們基于輸入單詞信息量的方法,可以更加平滑自然的顯示神經(jīng)網(wǎng)絡(luò)內(nèi)部信息處理邏輯。

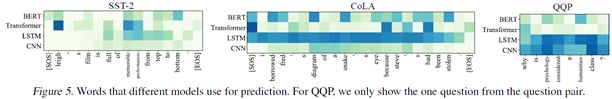

基于神經(jīng)網(wǎng)絡(luò)中層信息量指標(biāo),分析不同神經(jīng)網(wǎng)絡(luò)模型的處理能力。我們分析比較了四種在NLP中常用的深度學(xué)習(xí)模型,即BERT, Transformer, LSTM, 和CNN。在各NLP任務(wù)中, BERT模型往往表現(xiàn)最好,Transformer模型次之。

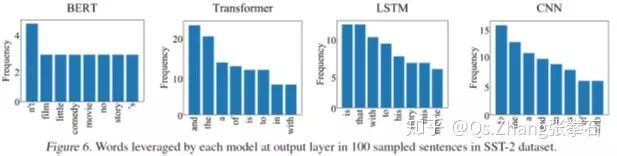

如下圖所示,我們發(fā)現(xiàn)相比于LSTM和CNN,基于預(yù)訓(xùn)練參數(shù)的BERT模型和Transformer模型往往可以更加精確地找到與任務(wù)相關(guān)的目標(biāo)單詞,而CNN和LSTM往往使用大范圍的鄰接單詞去做預(yù)測。

進(jìn)一步,如下圖所示,BERT模型在預(yù)測過程中往往使用具有實(shí)際意義的單詞作為分類依據(jù),而其他模型把更多的注意力放在了and the is 等缺少實(shí)際意義的單詞上。

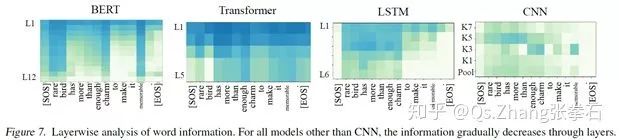

如下圖所示,BERT模型在L3-L4層就已經(jīng)遺忘了EOS單詞,往往在第5到12層逐漸遺忘其他與情感語義分析無關(guān)的單詞。相比于其他模型,BERT模型在單詞選擇上更有針對性。

我們的方法可以進(jìn)一步細(xì)粒度地分析,各個單詞的信息遺忘。BERT模型對各種細(xì)粒度信息保留的效果最好。

十多年前剛剛接觸AI時總感覺最難的是獨(dú)立找課題,后來發(fā)現(xiàn)追著熱點(diǎn)還是很容易拍腦袋想出一堆新題目,再后來發(fā)現(xiàn)真正想做的課題越來越少,雖然AI領(lǐng)域中學(xué)者們的投稿量一直指數(shù)增長。

回國以后,身份從博后變成了老師,帶的學(xué)生增加了不少,工作量也翻倍了,所以一直沒有時間寫文章與大家分享一些新的工作,如果有時間還會與大家分享更多的研究,包括這篇文章后續(xù)的眾多算法。信息量在CV方向應(yīng)用的論文,以及基于這些技術(shù)衍生出的課題,我稍后有空再寫。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4812瀏覽量

103318 -

AI

+關(guān)注

關(guān)注

88文章

34909瀏覽量

277866

原文標(biāo)題:上海交大張拳石:神經(jīng)網(wǎng)絡(luò)的可解釋性,從經(jīng)驗(yàn)主義到數(shù)學(xué)建模

文章出處:【微信號:rgznai100,微信公眾號:rgznai100】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

神經(jīng)網(wǎng)絡(luò)RAS在異步電機(jī)轉(zhuǎn)速估計(jì)中的仿真研究

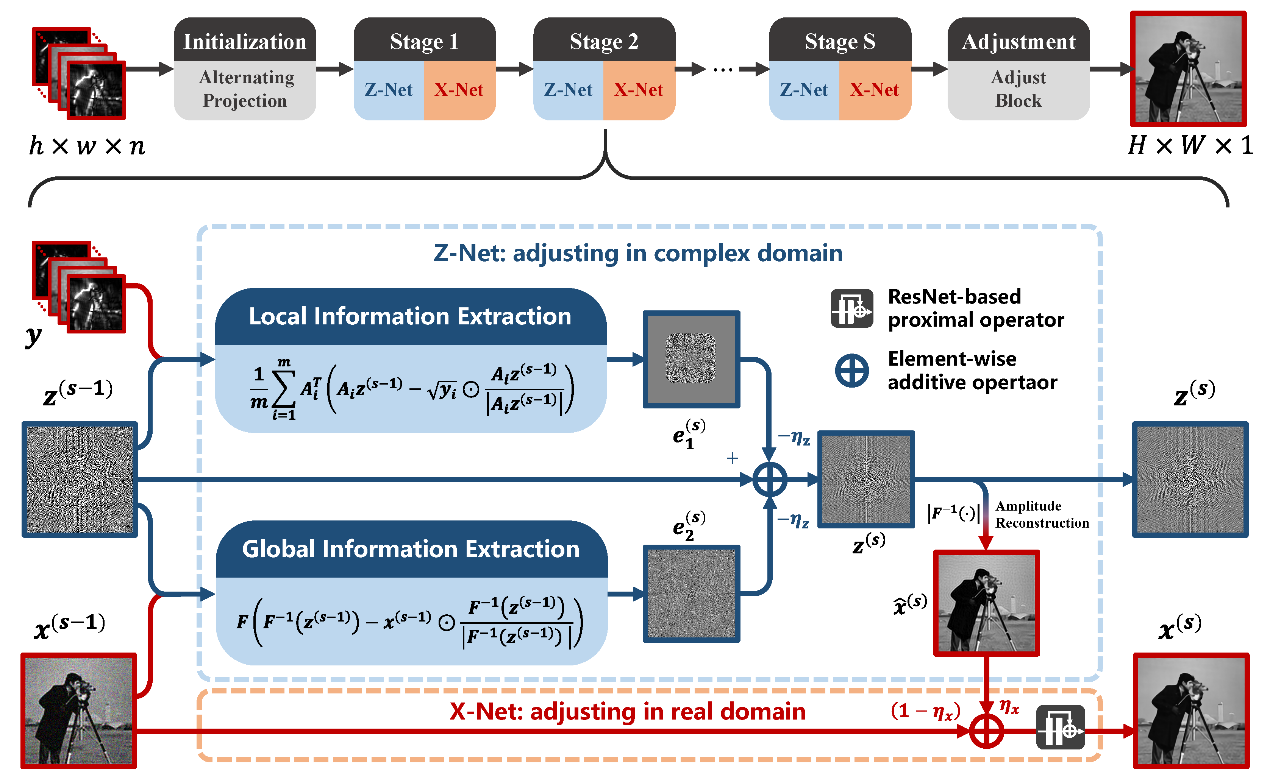

中國科學(xué)院西安光機(jī)所在計(jì)算成像可解釋性深度學(xué)習(xí)重建方法取得進(jìn)展

如何優(yōu)化BP神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)率

小白學(xué)解釋性AI:從機(jī)器學(xué)習(xí)到大模型

數(shù)據(jù)智能系列講座第3期—交流式學(xué)習(xí):神經(jīng)網(wǎng)絡(luò)的精細(xì)與或邏輯與人類認(rèn)知的對齊

神經(jīng)網(wǎng)絡(luò)可解釋性研究的重要性日益凸顯

神經(jīng)網(wǎng)絡(luò)可解釋性研究的重要性日益凸顯

評論